Aktuell verbreitet sich ein Video plattformübergreifend. Es zeigt einen Mann vor einem Landesgericht, ein Mikrofon, Untertitel – und die klare Botschaft: Ein Syrer wolle mehr Geld vom Jobcenter.

Der gezeigte Fall ist nicht belegt. Das Video ist als KI-generiert gekennzeichnet – allerdings nur in der ursprünglichen TikTok-Version.

Im Clip ist ein Mann vor einem Gebäude zu sehen, das wie ein Gericht wirkt. Er spricht in ein Mikrofon, Untertitel ordnen seine Aussagen ein. Eine Sprecherstimme fasst die Situation zusammen, später folgt ein Schnitt zu einer zweiten Person, die als Anwalt dargestellt wird.

Inhaltlich wird folgende Geschichte erzählt: Der Mann gebe an, nicht arbeiten zu können, weil er viele Kinder habe und eine zweite Frau plane. Laut Video erhalte er aktuell 6.000 Euro, das reiche jedoch nicht aus. Er fordere deshalb vor Gericht 10.000 Euro vom Jobcenter.

Wörtlich heißt es unter anderem, er habe „viele Kinder“ und es bleibe am Ende „nichts übrig“. Zudem fordert er mehr Geld, um seine Familie zu versorgen, und begründet dies mit steigenden Kosten im Alltag.

In einem weiteren Abschnitt wird ein angeblicher Anwalt eingeblendet. Dieser behauptet, der Kläger sehe sich nicht in der Pflicht zu arbeiten und könne seine Familie nicht ausreichend finanzieren.

Die Szene wirkt wie ein kurzer Nachrichtenbeitrag.

Ein überprüfbarer Beleg für diesen geschilderten Fall fehlt vollständig.

Der Hinweis auf die KI-Erstellung ist in vielen Versionen nicht mehr sichtbar. Das Video wurde heruntergeladen, neu hochgeladen oder als Ausschnitt verbreitet. Dabei geht die ursprüngliche Kennzeichnung verloren oder wird nicht übernommen.

Erst durch die Recherche lässt sich der Ursprung nachvollziehen: Die erste Version auf TikTok enthält den Hinweis, dass der Inhalt KI-generiert ist. Viele Nutzer sehen jedoch nur spätere Kopien ohne diesen Kontext.

Damit verändert sich die Wahrnehmung grundlegend:

Aus einem gekennzeichneten KI-Clip wird ein scheinbar echter Einzelfall.

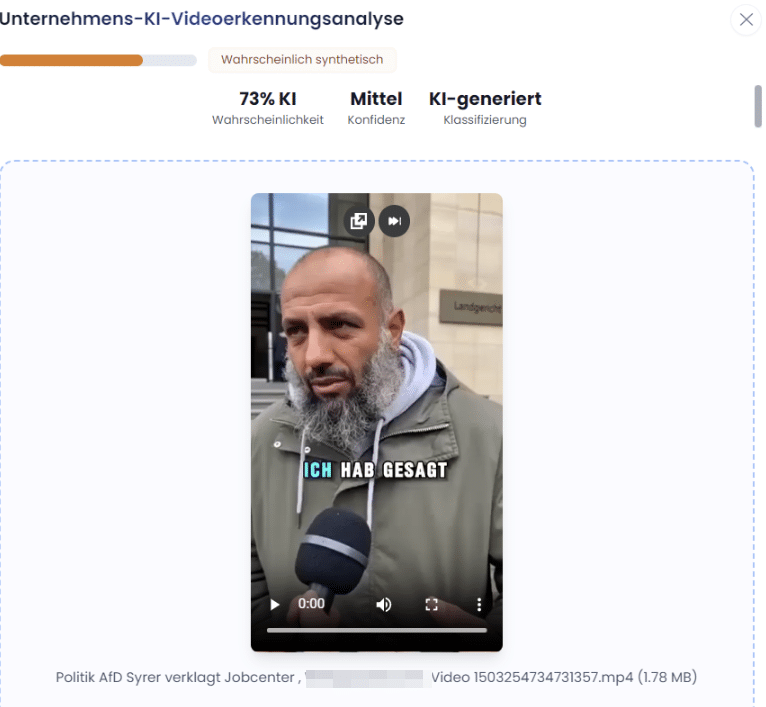

Zusätzlich wurde das Video mit einem Analyse-Tool geprüft. Dieses stuft den Clip mit einer Wahrscheinlichkeit von rund 73 Prozent als KI-generiert ein, bei mittlerer Konfidenz.

Solche Ergebnisse sind kein endgültiger Beweis, liefern jedoch einen weiteren Hinweis, der zur Einordnung des Materials beiträgt.

Die Szene ist auf Empörung gebaut

Das Video arbeitet mit mehreren Reizbegriffen gleichzeitig: Syrer, Jobcenter, Bürgergeld, 10.000 Euro, zweite Frau, viele Kinder, PlayStation. Jeder dieser Begriffe kann bereits für sich Debatten auslösen. Zusammen ergeben sie eine hochwirksame Empörungsformel.

Der Mann wird nicht als Mensch mit überprüfbarer Geschichte gezeigt, sondern als Projektionsfläche. Er soll genau das verkörpern, was viele Nutzer ohnehin vermuten oder ablehnen: jemand, der angeblich nicht arbeiten will, viele Kinder hat, staatliche Leistungen fordert und „dem System“ zur Last fällt.

Nicht der Fall ist die Botschaft, sondern das Feindbild.

Die Interview-Optik schafft Vertrauen

Auffällig ist die Machart. Das Video sieht aus wie ein kurzer Nachrichten- oder Straßeninterview-Clip. Es gibt ein Mikrofon, eine Gerichtskulisse, Untertitel, eine Sprecherstimme und später einen angeblichen Anwalt.

Diese Elemente erzeugen Vertrautheit. Viele Nutzer kennen solche Bilder aus echten Interviews, Reportagen oder Nachrichtenausschnitten. Genau dadurch bekommt eine künstlich erzeugte Szene den Anschein von Realität.

Der Hinweis „KI-generiert“ steht zwar im Video. Doch die Bilder arbeiten stärker als der Hinweis. Wer emotional bereits angesprochen ist, nimmt die Kennzeichnung oft nur noch als Nebensache wahr.

Viele Kommentare glauben dem Gefühl

Unter dem Video zeigen sich typische Reaktionen. Einige Nutzer schreiben, solche Fälle gebe es wirklich. Andere erklären, es sei egal, ob das Video KI-generiert sei, weil es „trotzdem so“ sei oder „so sein könnte“.

Damit verschiebt sich die Debatte. Es geht nicht mehr um die Frage, ob dieser konkrete Fall stimmt. Es geht darum, ob die erfundene Szene zu einem vorhandenen Weltbild passt.

Genau darin liegt die Wirkung solcher KI-Clips. Sie müssen nicht als wahr bewiesen werden. Es reicht, wenn sie sich für manche Menschen wahr anfühlen.

Aus Fake wird gefühlte Realität

Der gefährliche Punkt ist nicht nur die Täuschung. Der gefährliche Punkt ist die Akzeptanz der Täuschung.

Wenn Nutzer sagen, es sei egal, ob ein Video künstlich erzeugt wurde, weil es „bestimmt solche Fälle“ gebe, verliert der Faktencheck seine einfachste Grundlage. Dann zählt nicht mehr der konkrete Beleg, sondern die gefühlte Plausibilität.

Wenn ein Fake nicht mehr stimmen muss, sondern nur noch passen soll, hat Desinformation ihr Ziel erreicht.

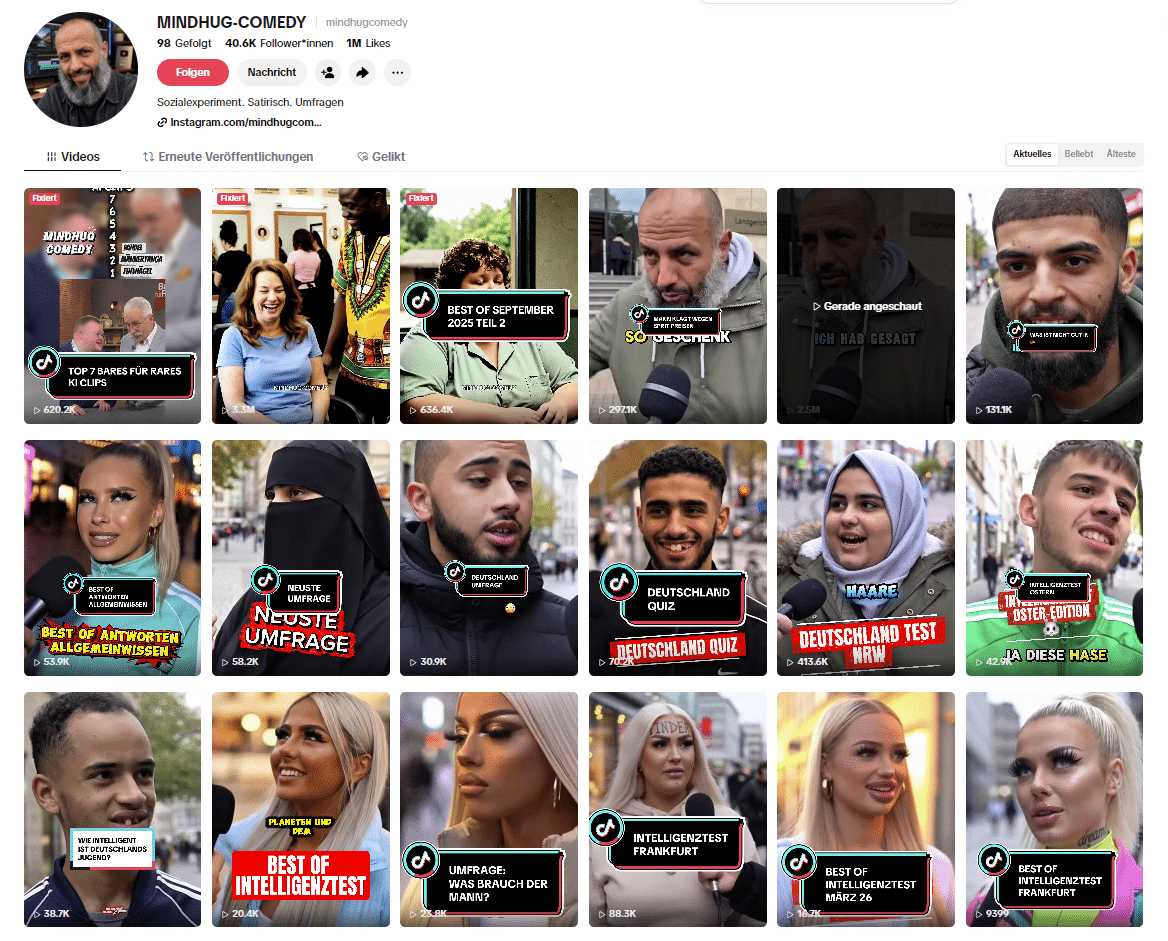

Der Kanal nutzt wiederkehrende Muster

Der Kanal hinter dem Video präsentiert sich mit Begriffen wie „Sozialexperiment“, „Satirisch“ und „Umfragen“. In der Übersicht finden sich zahlreiche Formate mit Straßeninterview-Optik, „Deutschland Test“, „Intelligenztest“, „Umfrage“ oder „Best of“.

Diese Formate folgen einem klaren Muster: Menschen werden in kurzen Szenen gezeigt, Antworten zugespitzt, Thumbnails arbeiten mit starken Kontrasten und Schlagwörtern. Der Inhalt wirkt spontan, ist aber auf schnelle Reaktion ausgelegt.

Das Bürgergeld-Video passt in diese Logik. Es ist keine nüchterne Satire mit klar erkennbarem Abstand, sondern eine Szene, die wie ein realer Fall aussieht und reale Wut produziert.

Die Kommentare zeigen reale Folgen

Unter solchen Videos bleibt es nicht bei Skepsis oder Spott. Die Kommentare kippen schnell in Verallgemeinerungen, Hass gegen Geflüchtete, Abwertung von Sozialleistungsbeziehenden und politische Mobilisierung.

Kommentare unter den verschiedenen Videos:

- „Ich würde gern schreiben, was ich denke, aber ich kann nicht.“

- „Ich arbeite beim Jobcenter und kann euch sagen: Solche Fälle gibt es.“

- „Ich arbeite seit Jahrzehnten und bekomme nicht mal annähernd so viel.“

- „Wenn das stimmt, höre ich sofort auf zu arbeiten.“

- „Das stand doch schon in der Zeitung.“

- „Kein Wunder, dass die Leute wütend werden.“

- „So etwas finanziere ich mit meinen Steuern sicher nicht.“

- „Da wundert mich nichts mehr in diesem Land.“

- „Genau deshalb wählen die Leute jetzt anders.“

- „Das ist leider Realität.“

- „Man darf das nicht mehr sagen, aber jeder weiß, dass es stimmt.“

- „Ich sehe solche Fälle ständig, das ist nichts Neues.“

- „Die Regierung schaut einfach weg.“

- „Und wir sollen jeden Tag arbeiten gehen?“

- „Das ist doch längst außer Kontrolle geraten.“

- „Das glaubt doch keiner mehr, dass das Einzelfälle sind.“

- „Kein Wunder, dass die Stimmung im Land kippt.“

- „Das wird alles noch schlimmer werden.“

oder auch

- „Leute, das ist als KI-Video gekennzeichnet.“

„Und? Trotzdem passiert sowas.“

„Nur weil es KI ist, heißt das nicht, dass es nicht stimmt.“ - „Das Video ist nicht echt, steht doch dabei.“

„Ist mir egal, ich kenne solche Fälle.“

„Genau, das ist Realität, auch wenn das Video fake ist.“ - „Das ist ein KI-Clip, kein echter Fall.“

„Aber genau so läuft es doch ab.“

„Man muss nicht alles glauben, aber ein Körnchen Wahrheit ist immer drin.“

Aus einem künstlich erzeugten Clip wird dann ein Anlass, ganze Gruppen abzuwerten. Einzelne Nutzer sprechen von Abschiebung, Sterilisation, „Schmarotzern“ oder davon, nun bestimmte Parteien wählen zu wollen.

Das zeigt die gesellschaftliche Wirkung: Ein KI-Video kann reale Ressentiments aktivieren. Es kann Menschen bestätigen, die ohnehin misstrauisch oder wütend sind. Und es kann eine Stimmung erzeugen, in der Gruppen nicht mehr als Menschen, sondern als Belastung wahrgenommen werden.

Warum solche Videos so gut funktionieren

Solche Clips sind kurz, emotional und leicht verständlich. Sie erzählen keine komplizierte Geschichte. Sie liefern eine einfache Rollenverteilung: hier die arbeitende Bevölkerung, dort angebliche Nutznießer des Systems.

Diese Vereinfachung ist der Kern. Sie macht aus einem komplexen Sozialrecht ein moralisches Drama. Aus Bürgergeld wird angeblicher Luxus. Aus einem KI-Mann wird ein Symbol. Aus Kommentaren wird sozialer Beweis.

Je mehr Menschen zustimmen, empört reagieren oder eigene Geschichten ergänzen, desto glaubwürdiger wirkt der Clip für andere. Die Kommentare werden Teil der Inszenierung.

Fazit

Der TikTok-Clip über einen angeblichen Syrer, der das Jobcenter wegen zu wenig Bürgergeld verklage, ist kein belegter echter Fall. Das Video ist als KI-generiert gekennzeichnet und arbeitet mit einer realistisch wirkenden Interview-Optik.

Die behauptete Forderung nach 10.000 Euro Bürgergeld wird nicht belegt und passt nicht zur gesetzlichen Logik von Regelbedarfen und angemessenen Unterkunftskosten.

Das eigentliche Problem ist größer als dieser eine Clip: KI-generierte Videos können eine gefühlte Realität erzeugen. Sie bestätigen Vorurteile, erzeugen Wut und machen aus erfundenen Szenen politische und gesellschaftliche Munition.

FAQ zum Thema: Syrer, Jobcenter und KI-Video

Verklagt ein Syrer wirklich das Jobcenter wegen Bürgergeld?

Für den im TikTok-Video gezeigten Fall gibt es keinen belastbaren Beleg. Der Clip ist als KI-generiert gekennzeichnet. Er sollte daher nicht als Nachweis für eine echte Klage verstanden werden.

Kann jemand einfach 10.000 Euro Bürgergeld fordern?

Bürgergeld wird nicht als frei wählbarer Wunschbetrag ausgezahlt. Es richtet sich nach gesetzlichen Regelbedarfen, Haushaltslage und angemessenen Kosten für Unterkunft und Heizung.

Warum wirkt das Jobcenter-Video so echt?

Das Video nutzt typische Merkmale echter Interviews: Mikrofon, Gerichtskulisse, Untertitel, Sprecherstimme und angeblichen Anwalt. Diese Elemente erzeugen Vertrauen, obwohl die Szene als KI-generiert gekennzeichnet ist.

Warum glauben viele Nutzer das Video trotzdem?

Viele Kommentare zeigen, dass der konkrete Wahrheitsgehalt für manche Nutzer zweitrangig wird. Entscheidend ist dann, ob die Szene in ein bestehendes Bild über Bürgergeld, Migration oder Staat passt. Genau dadurch wirken solche KI-Clips besonders stark.

Hinweis: Stand zum Veröffentlichungsdatum.

Verwendete Bilder, Screenshots und Medien dienen ausschließlich der sachlichen Auseinandersetzung im Sinne des Zitatrechts (§ 51 UrhG).

Teile dieses Beitrags können KI-gestützt erstellt und redaktionell geprüft worden sein.

(Mehr zur Arbeitsweise)